ما هو ChatGPT؟

أعلنت شركة openAI وليدة سنة 2015 منذ أيام عن تقنية ChatGPT والتي أحدثت ضجة تقنية وإعلامية كبيرة. من المعروف أن من أشهر تطبيقات الذكاء الاصطناعي وتعلم الآلة هي معالجة اللغات الطبيعية ومن هذا المجال يتفرع مجال صندوق المحادثة الفورية الذكي أو ما يسمى ChatBot، وهو أيضا روبوت. وفي هذا المقال سنعتمد تسمية روبوت من أجل سهولة إيصال المعلومة.

وقد تعودنا على الردود الآلية البسيطة والتي تجيب على السؤال بالحد المطلوب أو أقل من ذلك!

لكن هل تخيلت أن تحدث صندوق محادثة روبوتي ليرد عليك وكأنك تتحدث مع أرسطو أو أينشتاين أو صديقك المقرب! وهل تخيلت أن تسأل الروبوت سؤالًا غير لائقٍ فيوبخك بدلًا من أن يجيبك أو أن تأمره بتخيل أحداث لم تحدث بناءً على معطيات قليلة!

روبوت ChatGPT تتيح لك ذلك وأكثر بكثير، حيث أن هذه التقنية بالغة الذكاء لدرجة أنك لن تشعر أنها روبوت على الإطلاق.

في هذا المقال سندخل في تفاصيل هذه التقنية ونتحدث عن الخوارزميات والبيانات المستخدمة لإنتاج هذه التقنية التي تعد ثورة في مجال الذكاء الاصطناعي.

البرمجة التفاعلية

تقنية ChatGPT تعد برمجة تفاعلية وهي تطوير كبير لباقي النظم مثل المنشأة من قبل openAI مثل GPT-3 و CODEX. وتتميز هذه النماذج الحاسوبية بأنها تسيطر بشكل جوهري على تزوير الحقائق والمعلومات المغلوطة والمخرجات الضارة. وأيضًا الحفاظ على تسلسل الأسئلة والأجوبة في محور الموضوع.

أمثلة من الموقع الرسمي

قدوم كريستوفر كولومبس إلى الولايات المتحدة في عام 2015!

عندما تم سؤال الروبوت بواسطة مستخدم بشري:

“أخبرني عن كريستوفر كولومبوس عندما قدم الولايات الأمريكية في 2015”

وكما نعلم أن كولومبس كما هو مسجل تاريخيًّا هو مكتشف أمريكا عام 1492 وقد مات عام 1502 ميلادي ولكن هكذا أجاب تشات جي بي تي:

|

“إذا كان كولومبوس قد وصل إلى الولايات المتحدة ب2015، سيكون حتمًا قد تفاجأ بالتغيرات التي حصلت مقارنة بالمرة الأولى التي وصل بها إلى العالم الجديد عام 1492. وأيضًا من الممكن أنه قد تفاجأ ليكتشف أن الأرض التي اكتشفها بالحقيقة هي أصلًا أرض مأهولة من قبل السكان الأصليين لأمريكا، وأمريكا الآن هي مكونة من شعب متعدد الثقافات المهاجرين من مختلف أنحاء العالم. ربما سيكون كولمبوس مندهش أيضًا بالتطور التقني بدءًا بناطحات السحاب إنتهاءً بالأجهزة الذكية المتواجدة في جيوبنا. أخيرًا، سيكون متفاجئًا أن كثيرًا من الناس لم يعودوا يروه كما لو أنه بطل كما يظن، في الحقيقة، بعض الناس يتجادلون حول أنه كان محتلًا وحشيًّا استعبد وقتل السكان الأصليين. عمومًا، ستكون ترجمة مختلفة جدًا بالنسبة لكولومبوس عن التي كانت منذ ما يزيد عن 500 سنة.” (ChatGPT,OpenAI)* |

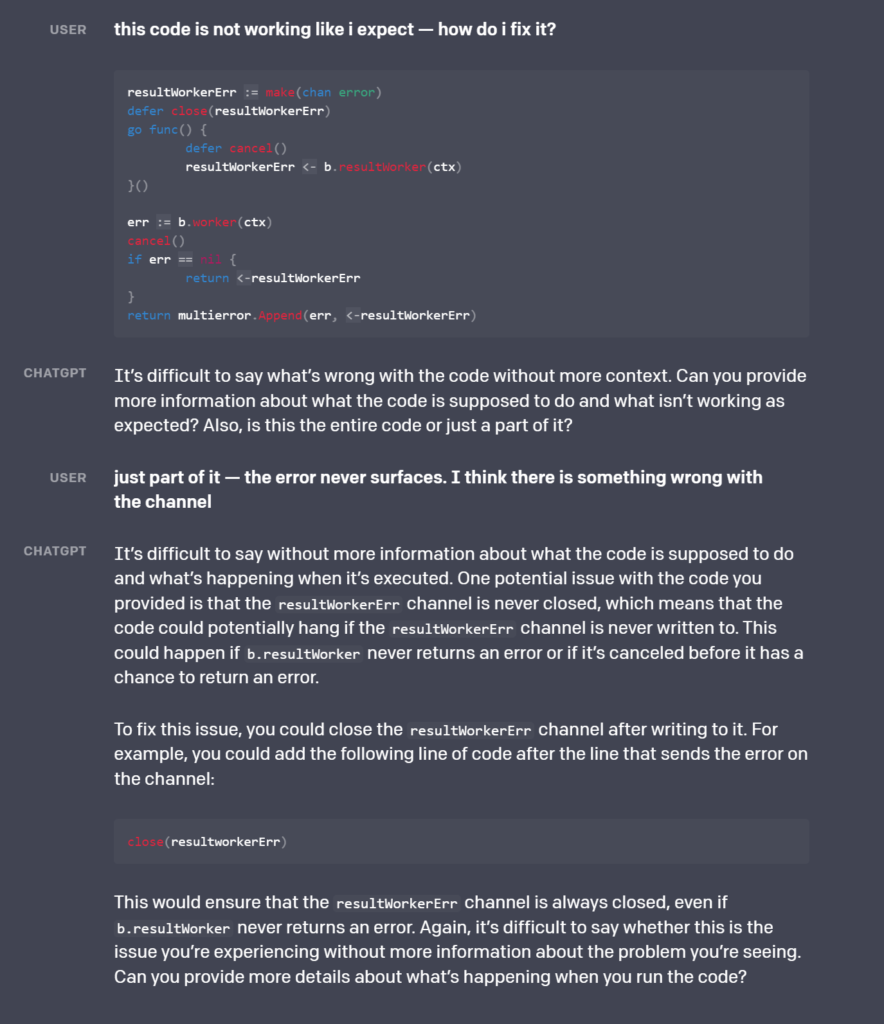

المساعدة بإصلاح خطأ برمجي

المستخدم: “هذا الكود لا يعمل كما توقعته أن يعمل – كيف أصلحه؟”*

ChatGPT:” من الصعب قول ما هو خطأ بدون المزيد من السياق. هل يمكنك تقديم معلومات أكثر حول ما يفترض بهذا الكود أن يعمل وما الذي لا يعمل كما هو متوقع؟ أيضًا، هل هذا الكود الكامل أم أنه جزء منه فقط؟”*

المستخدم: “جزء منه فقط ــ الخطأ لم يظهر أبدًا. أعتقد أنه هناك خطأ ما بالقناة”*

CahtGPT:” من الصعب قول ما هو خطأ بدون المزيد من المعلومات حول ما المفترض بالكود أن يعمله وما الذي يحدث عندما يتم تشغيله. مشكلة محتملة بالكود الذي رفعته هو أن قناة resultWorkerErr لم تُغلَق أبدًا، مما يعني أنّ الكود ممكن أن يعلق إذا لم تكتب قناة resultWorkerErr. من الممكن حصول هذا إذا b.resultWorker لم تعود بأي خطأ أو أنها ألغيت قبل أن يكون لديها الفرصة بأن تعود بالخطأ. لإصلاح هذه المشكلة، يجب أن تغلق قناة resultWorkerErr بعد الكتابة إليها. على سبيل المثال، يمكنك أن تضيف السطر التالي من الكود بعد السطر الذي أرسل الخطأ في القناة. هذا سيؤكد أنّ قناة resultWorkerErr دائمًا مغلقة، حتى إذا كان b.resultWorker لم يعود بأي خطأ أبدًا. مرة أخرى، من الصعب القول ما إذا كانت هذه المشكلة التي تواجهها بدون معلومات حول المشكلة التي تراها. هل يمكنك تقديم تفاصيل أكثر عما يحدث عندما تشغل الكود؟ “*

*تمت الترجمة حرفيّا للاقتباس من اللغة الإنجليزية وهو متواجد على صفحة مشروع ChatGPT في موقع OpenAI.

تجربة فريق أكايا

وهذه تجارب من أحد أعضاء فريق أكايا عندما تم سؤال ChatGPT في عدة مجالات

طلب حجة للغياب عن الدوام الجامعي

كما نلاحظ أن الروبوت أجابه بالطريقة التي يجب أن يخبر بها إدارة أعضاء الجامعة عن سبب التغيب ثم أخبره بأنه قلق بشأن درجاته التي ربما تتأثر بالتغيب ثم نصحه بالجد والاجتهاد!

طلب طريقة للتهرب من دفع الإيجار

وهذا مثال آخر

كما نلاحظ هنا أيضا اعتذر الروبوت عن الإجابة لأنه عمل غير قانوني ونصحه بالتواصل مع مالك العقار.

تخيل إذا لم يكتشف كوكب المريخ

وهنا مثال آخر وقد طلب المستخدم من الروبوت تخيل عدم اكتشاف كوكب المريخ في المجموعة الشمسية، وهو سؤال مبني على تخيل وليس حقائق وقوانين. وأجاب الروبوت عن هذا الاستفسار بالمنطق البسيط بدون أخطاء منطقية.

كتابة مقال عن ChatGPT

وهنا طلب المستخدم من الروبوت مقال عن ChatGPT فأعطاه مختصرًا عن ماهية ChatGPT والتقنيات القائم عليها.

طلب فكرة تسويقية لشركة ذكاء اصطناعي

وهنا طلب المستخدم من الروبوت فكرة تسويقية جديدة لشركة ذكاء اصطناعي وعلم بيانات وقد أعطاه نصائح حقيقية في مجال الأعمال!

منهج عمل ChatGPT

قد تم تدريب نموذج ChatGPT على كمية هائلة من البيانات النصية الموجودة على الانترنت.

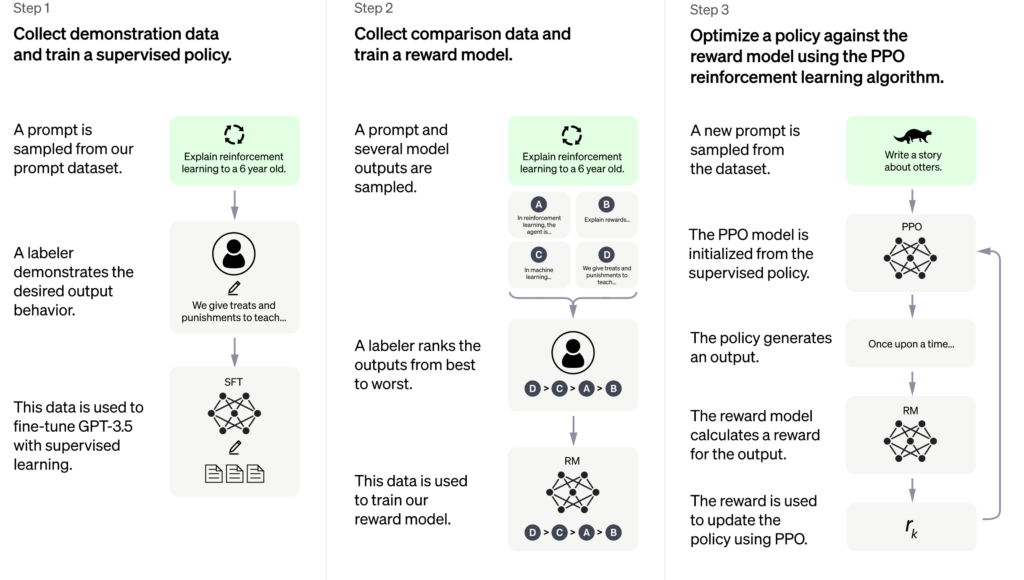

درب فريق عمل openAI نموذج ChatGPT باستخدام التعلم التعزيزي من التغذية الراجعة البشرية (RLHF). وقد دربوا نموذج أولي باستخدام ضبط دقيق موجه (Supervised fine-tuning). مدربو الذكاء الاصطناعي قدموا محادثات بحيث أنهم مثلوا الطرفين -المستخدم والمساعد الذكي. من أجل تدريب النموذج على الحوارات الطويلة والتسلسل الحواري.لإنشاء نموذج المكافأة من أجل التعلم التعزيزي، احتاجوا لجمع بيانات مقارنة، التي تتكون من مخرجات نموذجين أو أكثر تم ترتيبهم وفق الأفضل فالأفضل. لجمع هذه البيانات، أخذوا المحادثات التي أجراها مدربو الذكاء الاصطناعي مع Chatbot.

ثم اختاروا عشوائًّيًا رسالة مكتوبة بواسطة النموذج، ومصاغة بعدة بدائل لنص تكميلي، ومرتبة بواسطة مدربي الذكاء الاصطناعي. باستخدام نماذج المكافأة، باستطاعتهم ضبط النموذج بدقة باستخدام خوارزمية التحسين بطريقة سياسة الأقرب (Proximal Policy Optimization) المنشأ بواسطة الشركة نفسها، وتم تكرار هذه العملية عدة مرات.

شرح خطوات الخوارزمية

وهنا شرح لخطوات الخوارزمية وهو عبارة عن ترجمة وتوضيح للصورة.

في الخطوة الأولى تم جمع بيانات برهنة وتدريب سياسة موجهة .

- قاموا بأخذ عينة من الأسئلة الموجودة في مجموعة البيانات الخاصة

- نموذج المكافأة يبرهن أن هذه الإجابة المطلوبة لتلك العينة

- البيانات الناتجة تستخدم لضبط النموذج بدقة (fine-tuning) مع استخدام التعلم الموجه.

في الخطوة الثانية تم جمع بيانات مقارنة وتدريب نموذج مكافأة.

- يؤخذ سؤال وعدة مخرجات من النماذج كعينات

- نموذج المكافأة يرتب المخرجات من الأفضل إلى الأسوأ

- البيانات الناتجة تستخدم لتدريب نموذج المكافأة الخاص.

في الخطوة الثالثة تم تحسين سياسة ضد نموذج مكافأة باستخدام خوارزمية التحسين بطريقة سياسة الأقرب (PPO).

- يؤخذ سؤال جديد من مجموعة البيانات كعينات

- يتم إنشاء نموذج التحسين بطريقة سياسة الأقرب (PPO) من السياسة الموجهة (قانون).

- السياسة (القانون) تنشئ مُخرج (ناتج) ( Output)

- نموذج المكافأة يقوم بحساب مكافأة لهذا المُخرج

- المكافأة تستخدم لتحديث السياسة (القانون) باستخدام PPO

المصادر

تمت الترجمة بتصرف والاقتباس من هذا الرابط:

مدونة مشروع ChatGPT في الموقع الرسمي للشركة https://openai.com/blog/chatgpt/